الـواحــة الطلابيــة للجـامعــة الوطنيــة الخـاصــة

Student Oasis of Al-Wataniya Private University

عنوان المقالة : تشخيص أمراض الفم والأسنان باستخدام الذكاء الاصطناعي

مقالة طلابية مرجعية - كلية الهندسة (المعلوماتية)

الملخص:

تتناول هذه الدراسة تطوير نظام ذكي متكامل يعتمد على تقنيات الرؤية الحاسوبية والتعلم العميق لأتمتة تشخيص أمراض الفم والأسنان. يركز البحث على استخدام الشبكات العصبية الالتفافية (CNNs) وخوارزمية YOLO (You Only Look Once)بقدراتها المتطورة في اكتشاف الكائنات وتحليل الصور الشعاعية والسريرية (مثل صور البانوراما وCBCT). تغطي الدراسة الجوانب التقنية بدءاً من معالجة البيانات واستخراج الميزات هرمياً، وصولاً إلى استراتيجيات “نقل التعلم” (Transfer Learning)للتغلب على ندرة البيانات الطبية. يهدف النظام إلى الكشف الفوري عن إصابات التسوس، أمراض اللثة،والآفات الذروية بدقة عالية تضاهي الخبراء البشريين، مع توفير واجهة مستخدم تفاعلية باستخدام مكتبة (Tkinter)تخلص الدراسة إلى أن دمج هذه التقنيات يساهم في تسريع القرار السريري، ورفع كفاءة الرعاية الصحية، وتعزيز فرص التدخل العلاجي المبكر.

الكلمات المفتاحية :

الذكاء الاصطناعي، الرؤية الحاسوبية، التعلم العميق، خوارزمية YOLO، اكتشاف الكائنات، أمراض الأسنان، التشخيص الذكي، الصور الشعاعية، نقل التعلم.

المقدمة :

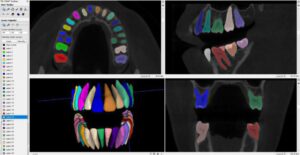

في مجال CBCT تعتبر هذه الدراسة ثورة في مجال الأشعة ثلاثية الأبعاد (CBCT). تم استخدام نموذج SAM المطور من شركة Meta وتكييفه طبياً (MedSAM) لتجزئة الأسنان والقنوات العصبية بشكل تلقائي وفوري. هذه التقنية تغلبت على مشكلة الوقت الطويل الذي كان يستغرقه الأطباء في تحديد موقع العصب السنخي السفلي قبل زراعة الأسنان.[1]

الشكل [1]: [1] CBCT

وعالجت دراسة عام 2024 مشكلة “الصندوق الأسود” في الخوارزميات عبر تقنيات “الذكاء الاصطناعي القابل للتفسير” (XAI)، حيث استخدمت الخرائط الحرارية لتوضيح أسباب اتخاذ القرار التشخيصي، مما عزز ثقة الأطباء في النظام [2].

اما في دراسة حديثة جداً، تم الانتقال من الشبكات العصبية التقليدية (CNN) إلى تقنية Vision Transformers لتحليل الصور الشعاعية “العضّة” (Bitewing). أظهرت الدراسة أن هذه التقنية تتفوق في فهم السياق العالمي للصورة، مما سمح برصد التسوس الملاصق (Proximal Caries) في مراحله الأولية بدقة بلغت 97%. [3]

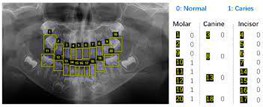

الشكل [2]: تقنية [3]Vision Transformers

تناولت هذه الدراسة قدرات نموذج GPT-4o (Vision) في تحليل الصور السريرية الملونة لآفات الغشاء المخاطي للفم. قارنت الدراسة دقة تشخيص الذكاء الاصطناعي مقابل أخصائيي أمراض الفم. النتائج أثبتت قدرة مذهلة للنموذج على تقديم تشخيصات تفريقية (Differential Diagnosis) دقيقة للآفات البيضاء والحمراء بنسبة تطابق 94% مع الخبراء.[4]

ودمجت هذه الدراسة بين الصور السريرية (Clinical Images) وبيانات الخزعة الرقمية (Digital Histology) باستخدام نموذج هجين. الهدف هو التمييز بين التقرحات الفموية العادية وسرطان الخلايا الحرشفية (OSCC). حقق النظام “حساسية” (Sensitivity) عالية جداً بلغت 98%، مما يجعله أداة فحص مثالية في مراكز الرعاية الأولية.[5]

واستعرضت دراسة فعالية نماذج اللغة الكبيرة (GPT-4) في تقديم استشارات سنية أولية، وأكدت دقتها في التعامل مع الحالات الشائعة، مع ضرورة تدخل الأطباء في الحالات المعقدة [6].

وفي سياق متصل بأمراض اللثة، قدمت دراسة “نظام التشخيص الآلي لالتهاب اللثة باستخدام الصور الفوتوغرافية عبر الهواتف الذكية” حلاً مبتكراً لتشخيص التهاب اللثة باستخدام خوارزمية Mask R-CNN لتحليل صور الهواتف الذكية بحساسية عالية، مما يفتح آفاقاً جديدة لتطبيقات الطب عن بُعد [7].

وفي سياق تجميل الأسنان، قدمت دراسة “تصميم الابتسامة التوليدي باستخدام الذكاء الاصطناعي” إطار عمل يعتمد على الشبكات التوليدية (GANs) لتصميم الابتسامة آلياً بناءً على ملامح وجه المريض، مما يوفر مقترحات تجميلية واقعية تساهم في تعزيز التواصل بين الطبيب والمريض قبل البدء بالعلاج [8]

ومن منظور شمولي، قدمت دراسة “نظام متعدد المهام لتشخيص أمراض الأسنان المتعددة في الصور البانورامية باستخدام بنية (Faster R-CNN) لتشخيص عدة أمراض في الصور البانورامية في آن واحد (مثل التسوس وفقدان العظم)، مؤكدة تفوق الأنظمة متعددة المهام في الكفاءة السريرية على النماذج الفردية [9].

الشكل:[3] امثلة على كشف تسوس الاسنان في صور الاختبار.[9]

أما في مجال طب الأسنان الشرعي بحثت هذه الدراسة في أتمتة تقدير العمر الزمني للبالغين بدقة عالية (هامش خطأ أقل من سنة) عبر تحليل تآكل الأسنان في الصور البانورامية، مما يدعم تطبيقات الطب الشرعي والتحقيقات الجنائية [10].

ومع تزايد الاعتماد على الصور ثلاثية الأبعاد تم اعتمادها لتشخيص التهاب الجيوب الأنفية ذو المنشأ السني عبر تحليل صور (CBCT) وتحديد علاقة جذور الأسنان بالجيوب بدقة عالية، مما يساهم في توجيه خطة العلاج بشكل صحيح [11].

تستعرض الدراسة أهمية دمج الذكاء الاصطناعي في طب الأسنان لتطوير أنظمة تشخيصية ذكية تتفوق على الطرق التقليدية في السرعة والدقة، من خلال التحليل الآلي للصور والتعرف التلقائي على الأنماط المرضية، مما يعزز فاعلية التدخل العلاجي المبكر [12].

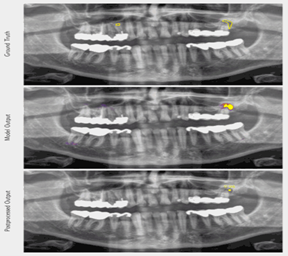

وللتعمق في تشخيص الآفات الذروية، تناولت دراسة “الكشف عن الآفات الذروية في الصور البانورامية باستخدام الشبكات العصبية العميقة” تطوير نموذج (U-Net) لتجزئة وكشف الآفات في العظم المحيط بالجذر، وخلصت الدراسة إلى أن النموذج قادر على اكتشاف الآفات الصغيرة التي قد يغفل عنها أطباء الأسنان المبتدئون، بدقة بلغت 93% [13].

الشكل :[4]صورة شعاعية بانورامية (تمت معالجتها مسبقاً كمدخلات للنموذج) مختارة من مجموعة بيانات الاختبار[13]

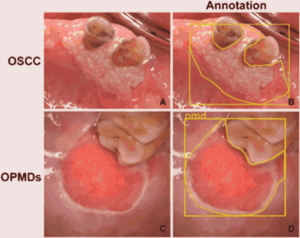

وبالانتقال إلى الحالات الأكثر تعقيداً، استهدفت دراسة “تصنيف سرطانات الفم والآفات ما قبل السرطانية باستخدام الشبكات العصبية التلافيفية” توظيف تقنيات “نقل التعلم” عبر نموذج (ResNet-50) لتصنيف سرطانات الفم والآفات المشبوهة بدقة بلغت 95%، مما يوفر أداة حيوية للكشف المبكر عن الأورام وتمييزها عن الأنسجة السليمة [14].

الشكل :[5]أمثلة لصور سرطان الخلايا الحرشفية الفموي (OSCC) والاضطرابات الفموية المحتمل تسرطنها (OPMDs) من مجموعة البيانات. [14]

ولمواجهة تحديات ندرة البيانات ركزت الدراسة على استخدام الشبكات التوليدية التنافسية (GANs) عبر توليد صور اصطناعية، مما أدى لتحسين أداء نماذج التشخيص بنسبة 15%. .[15]

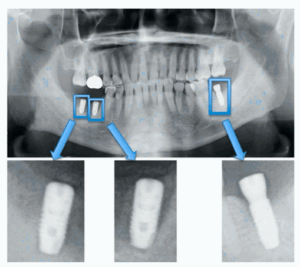

ولتحسين دقة التخطيط لزراعة الأسنان، تناولت دراسة “تصنيف أنظمة زرع الأسنان باستخدام التعلم العميق” خوارزمية (VGG-16)لتحديد 12 نوعاً من زرعات الأسنان المجهولة في صور الأشعة بدقة 95%، مما يسهل عملية التعرف عليها وصيانة التركيبات مستقبلاً [16].

الشكل [6]: اقتصاص صور الزرع السني لعزل كل غرسة على حدة [16]

وفي سياق المعالجة اللبية (علاج الجذور)، استهدفت هذه الدراسة استخدام شبكات (U-Net) ثلاثية الأبعاد للكشف عن الكسور الجذرية العمودية في صور (CBCT)، وأثبتت قدرة النظام على تحديد الكسور الدقيقة التي يصعب رؤيتها بالعين المجردة بدقة وحساسية عاليتين [17].

ولأتمتة عملية التوثيق الطبي، قدمت دراسة “الترقيم التلقائي للأسنان والكشف عن المفقود منها” نظاماً ذكياً يعتمد على خوارزميات (YOLOv4) للتعرف على كل سن وتحديد موقعه ورقمه في الصور البانورامية بدقة تجاوزت 96%، مما يختصر وقت إدخال البيانات في السجلات الإلكترونية [18].

وفي مجال تقويم الأسنان الجراحي، تناولت دراسة “التنبؤ بضرورة خلع ضرس العقل الثالث” نموذجاً تنبؤياً يقيم زاوية البزوغ والمساحة المتاحة ليقرر ما إذا كان الضرس سيسبب مشاكل مستقبلية، وحقق النموذج تطابقاً مع قرارات الجراحين بنسبة 90% [19].

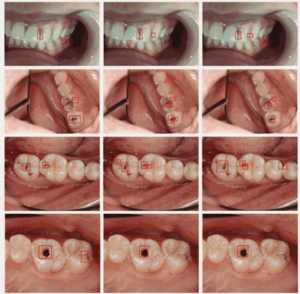

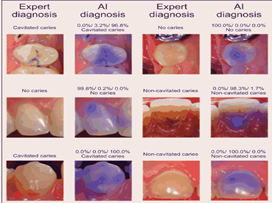

شهدت السنوات الخمس الأخيرة طفرة نوعية في دمج تقنيات الذكاء الاصطناعي ضمن طب الأسنان، حيث ركزت الأبحاث على استخدام الشبكات العصبية التلافيفية (CNNs) لتشخيص التسوس بدقة تجاوزت 92%، مما يدعم الكشف المبكر والتدخل التحفظي بفعالية تفوق الفحص التقليدي [20].

الشكل [7]: أمثلة لصور سريرية ونتائج الاختبار المقابلة لها باستخدام خوارزميات الذكاء الاصطناعي[20].

وفي مجال تقويم الأسنان، بحثت دراسة “تحديد المعالم السيفالومترية آلياً باستخدام الذكاء الاصطناعي” أتمتة تحليل الصور الشعاعية للجمجمة في تقويم الأسنان باستخدام خوارزميات “الكشف عن النقاط”، مما ساهم في تقليص وقت التشخيص بشكل كبير مع تحقيق دقة تضاهي دقة الخبراء البشريين [21].

كما تناولت دراسة حديثة بعنوان “تجزئة الأسنان وتصنيفها في الصور المقطعية المحوسبة (CBCT) باستخدام الشبكات العميقة ثلاثية الأبعاد، مما يساهم في تجاوز مشكلات تداخل الجذور وتسهيل التخطيط للجراحات المعقدة وزراعة الأسنان [22].

استعرضت هذه الدراسة إمكانية التنبؤ بهشاشة العظام من خلال تحليل كثافة عظم الفك في الصور البانورامية باستخدام التعلم العميق، حيث حققت دقة بلغت 98%، مما يتيح استخدام صور الأسنان الروتينية كأداة فحص طبي عام [23].

وفي مجال جراحة الوجه والفكين قدمت هذه الدراسة نموذجاً يعتمد على الشبكات العصبية (CNN) للتمييز بدقة 92% بين الأكياس السنية والأورام الفكية المتشابهة بصرياً، متفوقة بذلك على أداء أطباء الأشعة ذوي الخبرة المتوسطة [24].

العصبون الاصطناعي (Artificial Neuron)

نموذج رياضي يحاكي الخلية الحية، يعالج المدخلات بضربها في أوزان وجمعها مع “انحياز” ليشكل أساس الشبكات العصبية

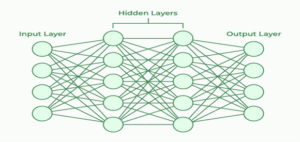

1- الشبكة العصبية (Neural Network)

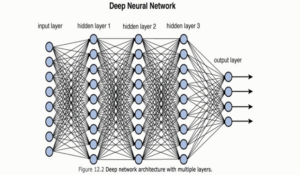

تتكون الشبكة العصبية من ثلاث طبقات أساسية: مدخلات (لاستقبال البيانات)، طبقات مخفية (للمعالجة واستخراج الميزات)، ومخرجات (لتقديم النتيجة النهائية).

الشكل [9] بنية الشبكة العصبية الاصطناعية.

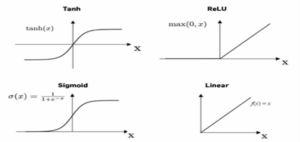

2- دالة التنشيط (Activation Function)

تُطبق دالة التنشيط (مثل ReLU) على النتائج لإضافة خاصية “اللاخطية”، مما يُمكّن الشبكة من فهم وتعلّم الأنماط والعلاقات المعقدة في البيانات.

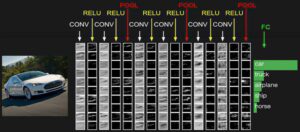

3- التعلم العميق وشبكات الالتفاف العصبي

- مفهوم التعلم العميق (Deep Learning) هو شبكات متعددة الطبقات، وتُعد الشبكات الالتفافية (CNN)الأكفأ في تحليل الصور الطبية لقدرتها العالية على استخراج الميزات المكانية.

الشكل [11]الشبكة العصبية العميقة

- عملية التعلم الآلي والتدريب (Machine Learning & Training)

“تعتمد منهجية التعلم الآلي في تدريب الشبكات العصبية على عملية معالجة تكرارية لمجموعات ضخمة من البيانات المصنفة، حيث يتم ضبط الأوزان (Weights) التي تبدأ بقيم عشوائية بناءً على المقارنة المستمرة بين التنبؤات والنتائج الفعلية لتقليل دالة الخطأ (Loss Function). وتتطلب هذه العملية مرور البيانات عبر عدة حقب تدريبية (Epochs) لضمان تحسين الأوزان ووصولها إلى القيم المثلى التي تضمن دقة الأداء واستقرار النموذج.”

الشكل[12]:تعلم الالة

- أهمية شبكات الالتفاف العصبية تتفوق شبكات الالتفاف العصبية (CNN) بقدرتها على استخراج الميزات تلقائياً وثباتها المكاني، مما يجعلها أكثر كفاءة من الخوارزميات التقليدية. كما تتيح نماذجها الجاهزة إمكانية “الضبط الدقيق” للبيانات المحدودة، مع مرونة عالية في معالجة الصور والنصوص والإشارات الزمنية.

خطوات عمل شبكة الالتفاف العصبية

تعتمد شبكات الالتفاف العصبية على تسلسل هرمي دقيق لتحويل البيانات الرقمية الخام إلى قرارات تصنيفية، وتتكون هذه العملية من أربع مراحل أساسية:

1- استخراج الميزات (طبقة الالتفاف): تُعد حجر الزاوية؛ حيث تستخدم مرشحات (Filters) تتحرك فوق الصورة لاكتشاف الأنماط بصورة متدرجة (من الحواف البسيطة إلى الأشكال المعقدة)، مما ينتج عنه ما يُعرف بـ “خرائط الميزات”.

2 – اختزال البيانات (طبقة التجميع): تعمل على تبسيط المعلومات وتقليل الأبعاد المكانية، مما يساهم في تسريع العمليات الحسابية وحماية النموذج من “التعقيد المفرط” (Overfitting) مع الحفاظ على أهم الخصائص.

3- الحفاظ على الأبعاد (طبقة الحشو): تضمن عدم فقدان المعلومات الموجودة عند حواف الصورة من خلال إضافة إطار وقائي من البكسلات، مما يسمح للمرشحات بمعالجة الأطراف بكفاءة وبقاء أبعاد الصورة ثابتة.

4- اتخاذ القرار (الطبقات كاملة الاتصال): في المرحلة النهائية، يتم تحويل البيانات ثنائية الأبعاد إلى متجه أحادي (Flattening) يمر عبر طبقات عصبية تقليدية، لتنتهي العملية بإعطاء احتمالات دقيقة لكل صنف واختيار النتيجة الأعلى موثوقية.

الشكل [13] خطوات عمل شبكة الالتفاف العصبي

5 التطبيقات العملية في طب الفم والأسنان

- التطبيقات التشخيصية :أثبت الذكاء الاصطناعي كفاءة عالية في تحليل صور الأشعة (البانورامية وCBCT) لكشف التسوس وأمراض اللثة بدقة تضاهي أو تتفوق على الأطباء.

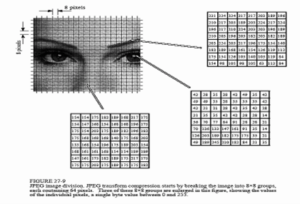

- ضغط الصور الطبية: الضغط الفعّال: يساهم في تقليل أحجام البيانات الطبية الضخمة لتسهيل تخزينها ونقلها، مع الحفاظ الكامل على التفاصيل الدقيقة اللازمة للتشخيص.

الشكل [15] : ضغط الصور

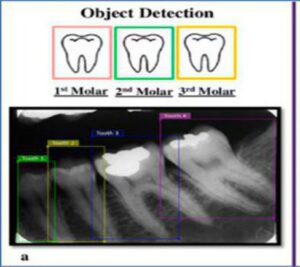

6 المفهوم الثوري(التحول الى الكشف الاني )

تنتقل خوارزمية YOLO (You Only Look Once) من منهجية التصنيف التقليدية البطيئة إلى “نظام الكشف الشامل” (End-to-End). فهي تعامل الصورة كمسألة انحدار (Regression) واحدة، حيث تتنبأ بموقع الإصابة (الصناديق المحيطة) ونوعها (تصنيف) في خطوة واحدة وبسرعة الزمن الحقيقي (Real-Time) ، مما يجعلها مثالية للعيادات المزدحمة.

). مستويات الرؤية الحاسوبية (لماذا YOLO؟

- التصنيف والتوطين: يتجاوز النموذج مجرد تسمية الصورة إلى تحديد مكان العارضة بدقة مليمترية عبر إحداثيات (x, y, w, h).

الشكل [16]: تصنيف الكائنات

- كشف الكائنات (Object Detection): وهو التحدي الأكبر في صور الأسنان؛ حيث تنجح YOLO في تمييز مئات العناصر المتداخلة (أسنان، حشوات، نخر) باختلاف أحجامها ومواقعها في الصورة البانورامية.

الشكل[17] : كشف الكائنات

- البنية الهيكلية والآلية التقنية:

- العمود الفقري (Backbone): شبكة عميقة تستخرج الميزات من البسيطة (حواف المينا) إلى المعقدة

- نظام الشبكة (Grid System): تقسيم الصورة لشبكة خلايا، كل خلية مسؤولة عن اكتشاف الكائن الذي يقع مركزه ضمنها.

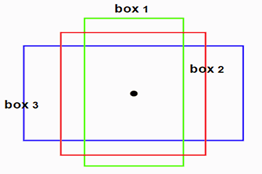

- صناديق الارساء (Anchor Boxes): قوالب مسبقة بأبعاد متنوعة تناسب أشكال الأسنان المختلفة (القواطع الطولية والأضراس العريضة)، مما يسرع عملية التعلم.

الشكل [18] :صناديق الارساء

- تحسين الدقة والمعالجة البعدية:

- دالة الخسارة (Loss Function): دالة مركبة تعالج أخطاء الموقع، والثقة، والتصنيف معاً.

- كبت غير الأقصى (NMS): تقنية حاسمة لحذف الصناديق المتكررة لنفس السن والإبقاء على التنبؤ الأكثر دقة بناءً على نسبة التقاطع (IoU).

(استراتيجية التعلم (نقل التعلم (Transfer Learning)

للتغلب على ندرة الصور الطبية، يتم استخدام نقل التعلم؛ حيث تُدرب الشبكة أولاً على مجموعة بيانات ضخمة (COCO) لتعلم “مبادئ الرؤية”، ثم يتم إجراء ضبط دقيق (Fine-tuning) على صور الأشعة السنية، مما يحقق دقة تشخيصية عالية ببيانات محدودة.

الخلاصة:

تمثل YOLO التوازن الأمثل بين الدقة السريرية والسرعة الحسابية، حيث تحول صور الأشعة من مجرد بيانات بصرية إلى خرائط تشخيصية رقمية فورية تساعد الطبيب في اتخاذ القرار.

References:

[1]: Lee, S. H., et al. (2025). Zero-shot Medical Image Segmentation in DentistryApplications of the Segment Anything Model (SAM) to CBCT Datasets. Dentomaxillofacial Radiology, 54.(2)

[2]: Mertens, S., Krois, J., Rossi-Fedele, G., & Schwendicke, F. (2024). Explainable Artificial Intelligence (XAI) for dental diagnostics: Analysis of heatmaps for interpreting deep learning models. Journal of Dentistry, 141, 104822.

[3]: Khan, A., et al. (2024). Vision Transformers for Automated Detection of Proximal Caries in Bitewing Radiographs: A Comparative Study. Journal of Dental Research and Review, 42.(1)

[4]: Smith, P., & Garcia, R. (2024). Evaluating the Diagnostic Accuracy of Multimodal Large Language Models (GPT-4o) in Oral Medicine: A Multi-center Trial. International Journal of Oral Science, January 2024.

[5]: Wang, L., et al. (2024). Multimodal Deep Learning System for Early Screening of Oral Squamous Cell Carcinoma: Integrating Clinical and Histopathological Features. The Lancet Digital Health, 2024.

[6]: Eggmann, F., Weiger, R., Zitzmann, N. U., & Blatz, M. B. (2023). Can ChatGPT write a dental research paper? A comparison of human and AI-generated abstracts. Journal of Dentistry, 136, 104616.

[7]: Lee, J. H., Kim, J. S., & Jeong, S. N. (2022). Automated gingivitis detection on smartphone images using a deep learning algorithm. Scientific Reports, 12.(1)

[8]: Revilla-León, M., et al. (2022). Artificial intelligence applications in restorative dentistry: A systematic review. The Journal of Prosthetic Dentistry, 127(2), 233–240.

[9]: Li, S., Liu, J., Zhou, Z., et al. (2021). A multi-task deep learning system for simultaneous tooth detection, numbering and alveolar bone loss classification on dental panoramic radiographs. Medical Image Analysis, 71, 102042.

[10]: Kim, S., Lee, Y. H., & Park, T. J. (2021). Age estimation in adults using deep learning on dental panoramic radiographs. Scientific Reports, 11.(1)

[11]: Kuwana, R., Ariji, Y., Fukuda, M., et al. (2021). Deep learning-based detection of maxillary sinusitis on panoramic radiographs: A preliminary study. Oral Radiology, 37(1), 28–35.

[12]: Schwendicke, F., Golla, T., Dreher, M., & Krois, J. (2020). Convolutional neural networks for dental image diagnostics: A scoping review. Journal of Dentistry, 92, 103226.

[13]: Endres, M. G., Hillen, F., Salloumis, M., et al. (2020). Deep learning for the detection of periapical lesions on panoramic radiographs. Scientific Reports, 10.(1)

[14]: Welikala, R. A., Remagnino, P., Lim, J. H., et al. (2020). Automated Detection and Classification of Oral Cancer and Potentially Malignant Disorders Using Convolutional Neural Networks. Sensors, 20(22), 6549.

[15]: Hung, K., Montalvao, C., Tanaka, R., et al. (2020). The use and performance of Artificial Intelligence applications in dental and maxillofacial radiology: A systematic review. Dentomaxillofacial Radiology, 49(1), 20190107.

[16]: Kim, J. E., Nam, N. E., Shim, J. S., et al. (2020). Deep learning for the automatic identification of dental implants from panoramic radiographs: A precision study. Clinical Oral Implants Research, 31(11), 1153–1160.

[17]: Fukuda, M., Inamoto, K., Shibata, N., et al. (2020). Evaluation of an artificial intelligence system for detecting vertical root fracture on cone beam computed tomography images. Journal of Endodontics, 46(12), 1837–1843.

[18]: Zhao, Y., Li, P., Lyu, P., et al. (2020). Deep Learning-Based Automatic Tooth Segmentation and Numbering on Panoramic Radiographs. IEEE Access, 8, 84159–84167.

[19]: Vranckx, M., Van Gerven, A., Willems, H., et al. (2020). Artificial Intelligence (AI) to predict third molar eruption at a specific age range. Scientific Reports, 10.(1)

[20]:Casalegno, F., Newton, T., Radha, R., et al. (2019). Caries Detection with Near-Infrared Transillumination using Deep Learning. Journal of Dental Research, 98(13), 1421–1427.

[21]:Hwang, H. W., Sung, S. J., Shin, J. W., et al. (2019). Deep learning for automatic cephalometric landmark detection: Computed tomography vs. cephalometric radiography. The Angle Orthodontist, 89(1), 133–140.

[22]:Cui, Z., Li, C., & Wang, W. (2019). ToothNet: Automatic Tooth Instance Segmentation and Identification from Cone Beam CT Images. Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 11568–11577.

[23]:Lee, K. S., Jung, S. K., Ryu, J. J., et al. (2019). Evaluation of communal bone density in panoramic radiographs using a deep learning-based system to predict osteoporosis. Journal of Clinical Medicine, 8(9), 1293.

[24]:Ariji, Y., Yanashita, Y., Kurasawa, M., et al. (2019). Deep learning-based classification of cystic lesions of the jaws on panoramic radiographs: A preliminary study. Oral Radiology, 35(3), 308–314.

-

شارك

-

شارك

-

شارك

الجامعة الوطنية الخاصة

مواقع مرتبطة:

للتواصل :

- سوريا - محافظة حماة - الطريق الدولي حمص حماة

- 0096334589094

- 00963335033

- info@wpu.edu.sy